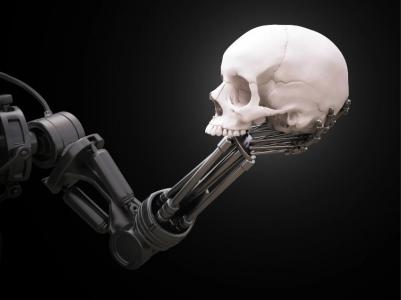

Бенгио, Маск и Возняк призвали приостановить обучение систем ИИ мощнее GPT-4

_____

Некоммерческая организация Future of Life опубликовала письмо, в котором глава SpaceX Илон Маск, соучредитель Apple Стив Возняк, филантроп Эндрю Янг и ещё около тысячи исследователей искусственного интеллекта призвали «немедленно приостановить» обучение систем ИИ, «более мощных, чем GPT-4».

В письме говорится, что системы искусственного интеллекта с «человеко-конкурентным интеллектом» могут нести «серьёзные риски для общества и человечества». В нём содержится призыв к лабораториям приостановить обучение на шесть месяцев.

«Мощные системы искусственного интеллекта следует разрабатывать только тогда, когда мы уверены, что их эффекты будут положительными, а их риски будут управляемыми», — подчёркивают авторы письма.

Под обращением подписались более 1125 человек, в том числе соучредитель Pinterest Эван Шарп, соучредитель Ripple Крис Ларсен, генеральный директор Stability AI Эмад Мостак, а также исследователи из DeepMind, Гарварда, Оксфорда и Кембриджа. Письмо подписали также тяжеловесы в области искусственного интеллекта Йошуа Бенджио и Стюарт Рассел. Последний также призвал приостановить разработку продвинутого ИИ до тех пор, пока независимые эксперты не разработают, внедрят и проверят общие протоколы безопасности для таких систем ИИ.

В письме подробно описаны потенциальные риски для общества и цивилизации со стороны конкурентоспособных систем искусственного интеллекта в виде экономических и политических потрясений.

Вот полный текст письма:

«Системы искусственного интеллекта, конкурирующие с человеком, могут представлять серьёзную опасность для общества и человечества, как показали обширные исследования и как признали ведущие лаборатории искусственного интеллекта. Как указано в широко одобренных принципах ИИ Asilomar, продвинутый ИИ может запустить глубокие изменения в истории жизни на Земле, и его следует разрабатывать и управлять им с соразмерной тщательностью и ресурсами. К сожалению, такого уровня планирования и управления не существует, даже несмотря на то, что в последние месяцы лаборатории искусственного интеллекта увязли в неконтролируемой гонке по разработке и развёртыванию все более мощных "цифровых умов", которые никто — даже их создатели — не могут понять, работу которых не могут прогнозировать или надёжно контролировать.

Современные системы искусственного интеллекта становятся конкурентоспособными в решении общих задач, и мы должны спросить себя: должны ли мы позволять машинам наводнять наши информационные каналы пропагандой и фейками? Должны ли мы автоматизировать все рабочие места, в том числе те, которые потенциально замещаемы ИИ? Должны ли мы развивать "нечеловеческие умы", которые в конечном итоге могут превзойти нас численностью, перехитрить и заменить? Должны ли мы рисковать потерей контроля над нашей цивилизацией? Такие решения не должны делегироваться неизбранным лидерам технологий. Мощные системы искусственного интеллекта следует разрабатывать только тогда, когда мы уверены, что их эффекты будут положительными, а риски —управляемыми. Эта уверенность должна быть хорошо обоснована и только расти с расширением потенциальных эффектов влияния таких систем. В недавнем заявлении OpenAI относительно общего искусственного интеллекта говорится, что "в какой-то момент может оказаться важным получить независимую оценку, прежде чем приступать к обучению будущих систем, и для самых передовых усилий согласиться ограничить скорость роста вычислений, используемых для создания новых моделей". Мы согласны. Этот момент наступил сейчас.

Поэтому мы призываем все лаборатории ИИ немедленно приостановить как минимум на шесть месяцев обучение систем ИИ более мощных, чем GPT-4. Эта пауза должна быть всеобщей и контролируемой, и в ней должны участвовать все ключевые участники. Если такую паузу нельзя установить быстро, то правительства должны вмешаться и ввести мораторий.

Лаборатории искусственного интеллекта и независимые эксперты должны использовать эту паузу для совместной разработки и внедрения набора общих протоколов безопасности для усовершенствованного проектирования и разработки искусственного интеллекта, которые будут тщательно проверяться и контролироваться независимыми внешними экспертами. Эти протоколы должны гарантировать, что системы, придерживающиеся их, вне всяких разумных сомнений безопасны. Это не означает паузу в развитии ИИ в целом, а просто шаг назад от опасной гонки к всё более крупным непредсказуемым моделям "чёрного ящика" с более широкими возможностями.

Исследования и разработки в области искусственного интеллекта должны быть переориентированы на то, чтобы сделать современные мощные современные системы ИИ более точными, безопасными, интерпретируемыми, прозрачными, надёжными, согласованными, заслуживающими доверия и лояльными.

Параллельно разработчики ИИ должны работать с политиками, чтобы значительно ускорить разработку надёжных систем управления ИИ. Эти усилия должны как минимум включать: новые и дееспособные регулирующие органы, занимающиеся вопросами ИИ; надзор и отслеживание высокопроизводительных систем искусственного интеллекта и больших пулов вычислительных мощностей; системы верификации и водяных знаков, помогающие отличить настоящий контент от сгенерированного и отслеживать утечки моделей; надёжную экосистему аудита и сертификации; ответственность за вред, причиненный ИИ; надёжное государственное финансирование технических исследований безопасности ИИ; хорошо обеспеченные ресурсами институты для преодоления серьёзных экономических и политических потрясений (особенно в демократических режимах), которые вызовет ИИ.

Человечество сможет наслаждаться процветающим будущим с ИИ. Добившись успеха в создании мощных систем, мы придём к "лету ИИ", когда будем пожинать плоды, разрабатывать эти системы на благо всех и давать обществу возможность адаптироваться к ним. Общество приостановило использование других технологий с потенциально катастрофическими последствиями. Мы можем применить эту меру и здесь».

Крупные лаборатории искусственного интеллекта, такие как OpenAI, пока не ответили на письмо.

«Письмо не идеально, но его дух правильный: нам нужно замедлиться, пока мы лучше не поймём все риски», — сказал Гэри Маркус, почетный профессор Нью-Йоркского университета, подписавший письмо. — «Системы ИИ могут причинить серьёзный вред... Крупные игроки становятся всё более скрытными в отношении того, что они делают».

OpenAI представила GPT-4 14 марта. Модель способна интерпретировать не только текст, но и изображения. Также она теперь распознаёт схематичные образы, в том числе и нарисованные от руки.

После анонса новой языковой модели OpenAI отказалась публиковать исследовательские материалы, лежащие в её основе. Участники сообщества ИИ раскритиковали это решение, отметив, что оно подрывает дух компании как исследовательской организации и затрудняет воспроизведение её работы другими. Одновременно это затрудняет разработку средств защиты от угроз, исходящих от систем ИИ.

- 1848 просмотров